El mandato negociador adoptado por 499 votos a favor, 28 en contra y 93 abstenciones en el pleno celebrado en Estrasburgo (Francia) reclama reglas estrictas para la Inteligencia Artificial en la Unión Europea, con un enfoque basado en el nivel de riesgo y restricciones en función del mismo.

La nueva Ley europea sobre Inteligencia Artificial que este mismo mes empezarán a negociar Eurocámara y Veintisiete parte de la propuesta presentada en abril de 2021 por la Comisión Europea para fijar estándares de seguridad y de derechos fundamentales que eviten que la tecnología se use con fines represivos, de manipulación o discriminatorios.

En este contexto, Bruselas abogó por distinguir sistemas de "alto riesgo" para prohibir "en principio su uso" pero dejando la puerta abierta a su autorización en circunstancias excepcionales y previa autorización judicial, por ejemplo en el caso de la vigilancia biométrica.

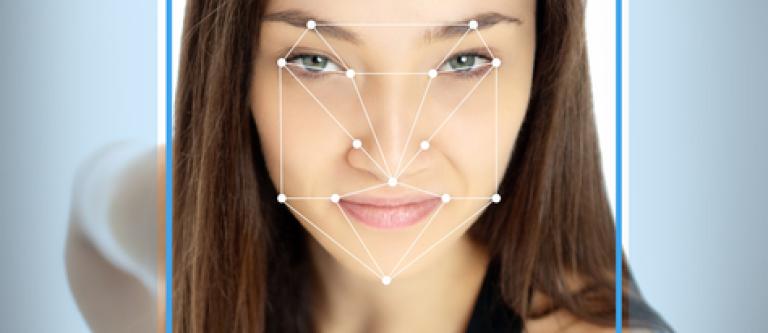

Los eurodiputados, sin embargo, van más allá y apuestan por prohibir totalmente el uso de herramientas para la vigilancia biométrica, el reconocimiento de emociones y los sistemas policiales predictivos.

Para ello, plantean que esos sistemas sean incluidos en el listado propuesto por Bruselas de herramientas que plantean un "riesgo inaceptable" y deben quedar prohibidas en todo caso.

En dicha lista figura ya el veto, por ejemplo, a aplicaciones de "puntuación social", como el sistema de "crédito social" que utiliza China para vigilar a sus ciudadanos, o a mecanismos de manipulación de la voluntad, por ejemplo instalados en juguetes con asistente de voz para incitar al menor a comportamientos peligrosos.

Con los cambios en la lista, los eurodiputados aspiran a vetar los sistemas de identificación biométrica remota, en tiempo real o no, en espacios públicos;

los sistemas de categorización biométrica que utilicen características identitarias como el género, la raza o la religión y los sistemas policiales predictivos.

Los negociadores de la Eurocámara también defenderán prohibir en todo caso el uso de sistemas de reconocimiento de emociones por las fuerzas de seguridad, en la gestión de fronteras, los lugares de trabajo o las instituciones de enseñanza; así como el rastreo indiscriminado de imágenes faciales sacadas de Internet o de circuitos cerrados de televisión para crear bases de datos de reconocimiento facial (porque violan los derechos humanos y el derecho a la intimidad).

Además piden considerar de alto riesgo sistema de IA que puedan afectar significativamente al medio ambiente o a la salud, a la seguridad o los derechos fundamentales de las personas, y aquellos que puedan influir en los votantes y el resultado de las elecciones y en los sistemas de recomendación utilizados por las plataformas de redes sociales (con más de 45 millones de usuarios).

La nueva legislación europea, pionera en el plano global, también establecerá normas estrictas para el uso de modelos de lenguaje artificial como ChatGPT, sistemas para los que los eurodiputados piden requisitos adicionales de transparencia, en especial para que deban alertar con avisos claros de que los contenidos han sido generados con Inteligencia Artificial y no se trata, por ejemplo, de imágenes reales.